Informační entropie

Informační nebo též shannonovská entropie je střední hodnota množství informace připadající na jeden symbol generovaný stochastickým zdrojem dat.

Míra informační entropie přiřazená ke každé možné datové hodnotě je záporným logaritmem pravděpodobnostní funkce dané hodnoty:

kde je střední hodnota definovaná pravděpodobností .[1]

Když datový zdroj vyprodukuje hodnotu (symbol), která má nízkou pravděpodobnost (tj. nastane událost s nízkou pravděpodobností), nese tato událost více „informace“ (způsobí větší „překvapení“), než vyprodukování hodnoty, která má pravděpodobnost vysokou. Pokud množství informace, které nese každá událost, považujeme za náhodnou veličinu, informační entropie je střední hodnota této náhodné události.

Entropie obecně vyjadřuje neuspořádanost nebo nejistotu, a definice entropie používaná v teorii informace je přímou analogií entropie používané ve statistické termodynamice. Koncept informační entropie představil Claude Shannon v roce 1948 ve svém článku „A Mathematical Theory of Communication".[2]

Základní model systému datové komunikace obsahuje tři prvky: zdroj dat, komunikační kanál a přijímač a – jak vyjádřil Shannon – „základním problémem komunikace“ je, aby přijímač byl schopen ze signálu, který přijímá z přenosového kanálu, identifikovat, jaká data byla vygenerovaná zdrojem.[3]:s.379–423 a 623–656 Entropie vyjadřuje absolutní dolní mez průměrné délky bezztrátového kódování dat vytvářených zdrojem. Pokud je entropie zdroje menší než kapacita komunikační kanálu, je možné data generovaná zdrojem spolehlivě přenést k přijímači (alespoň teoreticky, případně se zanedbáním určitých praktických kritérií jako například času potřebného pro přenos dat a složitosti systému k tomuto účelu).

Informační entropie se nejčastěji měří v bitech (kterým se v této souvislosti také říká „shannons“), někdy v „přirozených jednotkách“ (natech) nebo v desítkových číslicích (nazývaný „dits“, „bans“ nebo „hartleys“). Jednotka měření závisí na základu logaritmu použitého pro výpočet entropie.

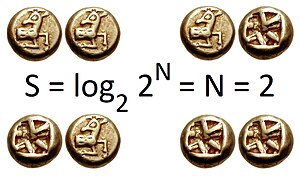

Logaritmus rozdělení pravděpodobnosti je vhodný jako míra entropie, protože pro nezávislé zdroje je aditivní. Například entropie vrhu poctivou mincí je 1 bit a entropie m vrhů je m bitů. V přímočaré reprezentaci je potřeba log2(n) bitů pro reprezentaci proměnné, která může nabývat jedné z n hodnot, jestliže n je mocninou dvojky, tj. n = 2k. Pokud jsou všechny hodnoty stejně pravděpodobné, entropie (v bitech) bude log2(n)= k. Pokud se jedna z hodnot bude objevovat častěji než ostatní, pozorování této hodnoty je méně informativní, než kdyby došlo k méně obvyklému výsledku. Naopak pozorování vzácnější události poskytuje více informace. Protože pozorování méně pravděpodobných událostí se objevují méně často, způsobují, že entropie (braná jako průměrná informace) pocházející z nerovnoměrně distribuovaných dat je vždy menší nebo rovna log2(n). Entropie je nulová, pokud je jisté, že nastane jedna určitá událost. Entropie je veličina, která kvantifikuje tato kritéria pro známé rozdělení pravděpodobnosti zdrojových dat. Entropie nezávisí na obsahu pozorovaných událostí (významu zprávy), ale bere v úvahu pouze pravděpodobnosti jejich výskytu. To znamená, že entropie závisí pouze na podkladovém rozdělení pravděpodobnosti, nikoli na významu událostí samých.

Úvod

Základní myšlenkou teorie informace je, že „informační hodnota“ předávané zprávy závisí na míře, jak je obsah zprávy překvapivý. Není žádným překvapením, když dojde k události, která je velmi pravděpodobná. Naopak, v případě málo pravděpodobných událostí, je jejich výskyt mnohem informativnější. Například znalost, že určité číslo nevyhraje v loterii, nese velmi malou informaci, protože jakékoli určité číslo téměř určitě nevyhraje. Ale znalost, že určité číslo v loterii vyhraje, má vysokou informační hodnotu, protože informuje o události s velmi nízkou pravděpodobností. Informační obsah (také nazývaný surprisal – překvapení) události je rostoucí funkcí převrácené hodnoty pravděpodobnosti události, přesněji . Entropie měří očekávané (tj. průměrné) množství informace obsažené v informaci o výsledku náhodného pokusu. Z toho vyplývá, že vrh kostkou má vyšší entropii než házení mincí, protože každý z výsledků vrhu kostkou má menší pravděpodobnost () než každý z výsledků vrhu mincí ().

Entropie je míra nepředvídatelnosti výsledku, jeho průměrného informačního obsahu. Chceme-li získat intuitivní porozumění těmto termínům, můžeme si představit průzkum veřejného mínění. Takové průzkumy se provádějí, aby se zjistila informace, která není známá. To znamená, že výsledek průzkumu je těžko předpověditelný a provedení průzkumu přináší nějakou novou informaci; to je jen jiný způsob jak říct, že apriorní entropie výsledků průzkumu je velká. Pokud by se stejný průzkum prováděl znovu, krátce po prvním průzkumu, když je výsledek prvního průzkum už známý, bylo by možné výsledek druhého průzkum dobře předvídat, a jeho výsledky sotva obsahují mnoho nové informace; to znamená, že apriorní entropie výsledku druhého průzkumu je relativně malá v porovnání s prvním průzkumem.

Uvažujme vrh mincí. Pokud pravděpodobnost padnutí panny je stejná jako pravděpodobnost padnutí orla, pak entropie vrhu mincí je stejně vysoká jako u libovolného pokusu se dvěma stejně pravděpodobnými výsledky. Výsledek vrhu mincí nelze předpovědět: pokud si máme vybrat, neexistuje žádná průměrná výhoda předvídat určitý výsledek, protože každá předpověď bude správná s pravděpodobností . Takový vrh mincí má jeden bit entropie, protože existují dva možné výsledky se stejnou pravděpodobností, a víme, že výsledek má jeden bit informace. Naproti tomu, vrh mincí, které by měla dvě panny a žádného orla má nulovou entropii, protože při vrhu takovou mincí vždy padne panna a výsledek lze dokonale předpovědět. Libovolná událost se stejně pravděpodobnými výsledky má Shannonovu entropii bit. Podobně každý pokus se třemi stejně pravděpodobnými hodnotami obsahuje (asi 1,58496) bitů informace, protože může nabývat jednu ze tří hodnot.

Pokud budeme anglický text považovat za řetězec znaků, má docela nízkou entropii; to znamená, že je docela dobře předvídatelný. I v případě, že nevíme přesně, jaký znak bude následovat, můžeme si být jisti, že například 'e' bude mnohem obvyklejší než 'z', nebo že kombinace 'qu' bude mnohem obvyklejší než 'q' následované jiným písmenem, a že i kombinace 'th' bude obvyklejší než 'z', 'q' nebo 'qu'. Zbytek slova můžeme často odhadnout z několika prvních písmen. Anglický text má entropii 0,6 až 1,3 bitů na znak zprávy.[4]:s.234

Pokud je komprimační schéma bezztrátové – takové, že původní zprávu lze vždy dekomprimovat – pak komprimovaná zpráva obsahuje stejné množství informace jako původní, ale je zakódována méně znaky. Obsahuje tedy více informace na znak (má vyšší entropii). Komprimovaná zpráva má menší redundanci. Shannonova věta o zdrojovém kódování říká, že bezztrátové komprimační schéma nemůže v průměru komprimovat zprávy, aby měly více než jeden bit informace na bit zprávy, ale, že jakoukoli hodnotu menší než jeden bit informace na bit zprávy lze dosáhnout použitím vhodného kódovacího schématu. Entropie zprávy na bit znásobená délkou zprávy je mírou, kolik informace zpráva celkem obsahuje.

Uvažujme, že bychom měli vysílat posloupnosti obsahující 4 znaky 'A', 'B', 'C' a 'D' – například zprávu 'ABADDCAB'. Teorie informace říká, jak spočítat nejmenší možné množství informace, kterou je třeba přenést. Jsou-li všechna 4 písmena stejně pravděpodobná (25 %), není možné najít lepší kódovací schéma (pro binární kanál), než zakódování každého písmene dvěma bity: 'A' například jako '00', 'B' jako '01', 'C' jako '10' a 'D' jako '11'. Pokud se však 'A' objevuje s 70% pravděpodobností, 'B' s 26%, a 'C' i 'D' s 2% pravděpodobností, bylo by možné přiřadit jednotlivým znakům kódy s různou délkou, takže přijetí '1' by znamenalo, že je třeba se podívat na jiný bit pokud žádná posloupnost 2 bitů jedniček už byla přijata. V tomto případě může být 'A' kódované jako '0' (jeden bit), 'B' jako '10' a 'C' a 'D' jako '110' a '111'. Je snadno vidět, že v 70 % případů stačí jeden bit informace, v 26 % případů dvou bitů a pouze ve 4 % případů 3 bitů. Průměrně stačí méně než 2 bity, protože entropie je nižší (kvůli vysoký prevalenci symbolů 'A' následovaných 'B' – současně 96 % znaků). Tento vliv zachycuje výpočet sumy pravděpodobnosti vážené logaritmem míry pravděpodobnosti.

Ze Shannonovy věty také vyplývá, že žádné bezztrátové komprimační schéma nemůže zkrátit úplně všechny zprávy. Pokud některé zprávy vyjdou kratší, alespoň jedna musí vyjít delší kvůli Dirichletově principu. Při praktickém použití to obecně není problém, protože typicky přenášíme pouze určitý typ zpráv, například dokumenty v angličtině nikoli náhodné řetězce znaků, nebo digitální fotografie a nikoli šum, a proto není důležité, že komprimační algoritmus nějaké nepravděpodobné nebo nezajímavé posloupnosti prodlužuje.

Definice

Shannon definoval entropii Η diskrétní náhodné proměnné s možnými hodnotami a pravděpodobnostní funkcí takto:

Pro entropii používá znak Η (velké řecké písmeno éta), podle Boltzmannovy Η-věty. je operátor střední hodnoty a I je informační obsah X.[5]:s.11[6]:s.19–20 je také náhodná proměnná.

Entropii můžeme explicitně zapsat jako

kde b je základ použitého logaritmu. V tomto případě se nejčastěji jako základ b používá hodnota 2, méně často Eulerovo číslo e, nebo 10. Entropie je pro b = 2 vyjádřena v bitech, pro b = e v jednotkách nazývaných nat a pro b = 10 v jednotkách nazývaných ban, hartley nebo dit.[7]

Pokud P(xi) = 0 pro nějaké i, bere se hodnota odpovídajícího členu 0 logb(0) nulová, což odpovídá limitě

Můžeme také definovat podmíněnou entropii dvou událostí a , které nabývají hodnot a , vzorcem

kde je pravděpodobnost, že a . Tuto hodnotu chápeme jako množství náhodnosti v náhodné proměnné pro danou hodnotu náhodné proměnné .

Příklad

Entropie je v tomto případě nejvýše 1 bit a předání výsledku vrhu mincí (se dvěma možnými výsledky) vyžaduje průměrně nejvýše 1 bit informace (pro poctivou minci je to přesně 1 bit). Zakódování vrhu poctivou kostkou (6 hodnot se stejnou pravděpodobností) vyžaduje průměrně log26 bitů.

Uvažujme házení mincí se známými, ne nutně poctivými pravděpodobnostmi, že padne panna nebo orel; to lze modelovat Bernoulliho procesem.

Entropie neznámého výsledku dalšího vrhu mincí je nejvyšší, jestliže mince je poctivá (tj. jestliže panna i orel mají stejnou pravděpodobnost 1/2). U poctivé mince je nejobtížnější předpovídat výsledek dalšího vrhu; výsledek každého vrhu mincí přináší celý jeden bit informace. Důvodem je, že

Pokud však víme, že mince není poctivá, ale pravděpodobnosti hodu panny případně orla jsou p, příp. q, kde p ≠ q, pak je nejistota menší. Při každém vrhu je pravděpodobnější, že padne jedna strana než druhá. Snížení nejistoty je kvantifikováno nižší entropií: každý vrh mincí přináší v průměru méně než jeden bit informace. Jestliže například p=0,7, pak

Rovnoměrné rozdělení pravděpodobnosti má maximální nejistotu a tedy maximální entropii. Entropie se pak může pouze snížit z hodnoty odpovídající rovnoměrné pravděpodobnosti. Extrémním případem je, že mince má dvě panny, takže nikdy nemůže padnout orel, nebo dva orly, takže nikdy nemůže padnout panna. Vrh takovou mincí v sobě neobsahuje žádnou nejistotu, žádnou novou informaci, protože výsledek vrhu je předem známý, takže entropie je nulová.

Entropii lze normalizovat tím, že ji vydělíme délkou informace. Výsledný poměr se nazývá metrika entropie a je mírou náhodnosti informace.

Zdůvodnění

Pro pochopení významu -∑ pi log(pi), nejdříve definujeme informační funkci I pomocí události i s pravděpodobností pi. Množství informace získané pozorováním události i vyplývá z Shannonova řešení základních vlastností informace:[8]

- I(p) je monotonně klesající v p: zvýšení pravděpodobnosti události snižuje množství informace získané pozorováním události a naopak.

- I(p) ≥ 0: informace je nezáporná veličina.

- I(1) = 0: události, ke kterým dojde vždy, nepřinášejí žádnou informaci.

- I(p1 p2) = I(p1) + I(p2): informace nezávislých událostí je aditivní.

Klíčová je poslední vlastnost. Říká, že sdružená pravděpodobnost nezávislých zdrojů informace přináší stejné množství informace jako obě události samostatně. Speciálně jestliže první událost je jedním z n stejně pravděpodobných výsledků a druhá jedním z m stejně pravděpodobných výsledků, pak sdružená událost má mn možných výsledků. To znamená, že jestliže je potřeba log2(n) bitů pro zakódování první hodnoty a log2(m) bitů pro zakódování druhé, potřebujeme log2(mn) = log2(m) + log2(n) pro zakódování obou. Shannon objevil, že funkce pro určení množství informace, zachovávající tuto aditivitu, je logaritmická, tj.,

Jestliže je informační funkce, o které předpokládáme, že je dvakrát spojitě derivovatelná, dostáváme:

Tato diferenciální rovnice má k řešení pro jakékoli . Z podmínky 2. vyplývá, že k . lze zvolit ve tvaru pro , což je ekvivalentní s výběrem určitého základu logaritmu. Různé jednotky informace (bity pro binární logaritmus log2, naty pro přirozený logaritmus ln, bany pro desítkový logaritmus log10 atd.) jsou konstantní násobky jiného. Pokud například uvažujeme vrh poctivou mincí, hození panny dává log2(2) = 1 bit informace, což je přibližně 0,693 natů nebo 0,301 desítkových číslic. n vrhů přináší díky aditivitě n bitů informace, což je přibližně 0,693n natů nebo 0,301n desítkových číslic.

Pokud existuje rozdělení, u kterého událost i může nastat s pravděpodobností pi a provedeme N pokusů, při kterých výsledek i nastane ni = N pi krát, celkové množství přijaté informace je

- .

Průměrné množství informace, kterou získáme z události je proto

Aspekty

Vztah k termodynamické entropii

Inspirace pro použití slova entropie v teorii informace pochází z podobnosti mezi Shannonovým vzorcem a velmi podobnými vzorci známými ze statistické mechaniky.

Nejobecnější vzorec pro termodynamickou entropii S termodynamického systému ve statistické termodynamice je Gibbsova entropie:

kde kB je Boltzmannova konstanta a pi je pravděpodobnost mikrostavu. Gibbsovu entropii definoval J. Willard Gibbs v roce 1878, krátce po publikaci díla Ludwiga Boltzmanna v roce 1872.[9]

Gibbsovu entropii lze použít téměř nezměněnou ve světě kvantové fyziky, kde dává von Neumannovu entropii, kterou zavedl John von Neumann v roce 1927:

kde ρ je matice hustoty kvantově mechanického systému a Tr je stopa matice.

Při každodenním praktickém používání není spojitost mezi informační entropií a termodynamickou entropií evidentní. Fyzici a chemici se spíše zajímají o změny entropie, protože systém se vyvíjí spontánně ze svých počátečních podmínek ve shodě s druhým zákonem termodynamiky, než o neměnné rozdělení pravděpodobnosti. Malá hodnota Boltzmannovy konstanty kB ukazuje, že změny S / kB i pro velmi malé množství látky v chemických a fyzikálních procesech reprezentuje entropii, která je extrémně velká v porovnání s čímkoli při kompresi dat nebo zpracování signálu. V klasické termodynamice je entropie definována pomocí makroskopických měření bez odkazů na nějaké rozdělení pravděpodobnosti, což je hlavním aspektem pro definici informační entropie.

Spojení mezi termodynamikou a tím, co nyní nazýváme teorie informace, si poprvé všiml Ludwig Boltzmann, který je vyjádřil svou proslulou rovnicí:

kde je termodynamická entropie určitého makroskopického stavu (definovaná termodynamickými parametry jako například teplotou, objemem, energií, atd.), W je počet mikroskopických stavů (různých kombinací částic v různých energetických stavech), které mohou dávat daný makroskopický stav a kB je Boltzmannova konstanta. Předpokládá se, že každý mikroskopický stav je stejně pravděpodobný, takže pravděpodobnost daného mikroskopického stavu je pi = 1/W. Pokud tyto pravděpodobnosti dosadíme do výše uvedeného výrazu pro Gibbsovu entropii (nebo ekvivalentně kB krát Shannonovu entropii), dostaneme Boltzmannovu rovnici. Použijeme-li termíny z teorie informace, je informační entropie systému rovna množství „chybějící“ informace potřebné pro určení mikroskopického stavu pro daný makroskopický stav.

V přístupu Edwina Thompsona Jaynese (1957) se na termodynamickou entropii, jak ji vysvětluje statistická mechanika, musí nahlížet jako na aplikaci Shannonovy teorie informace: termodynamická entropie se interpretuje jako množství další Shannonovy informace potřebné pro určení konkrétního mikroskopického stavu systému, který při popisu systému výhradně makroskopickými proměnnými klasické termodynamiky zůstává skrytý, přičemž konstanta úměrnosti je právě Boltzmannova konstanta. Dodáváním tepla do systému se zvyšuje jeho termodynamická entropie, protože se zvyšuje počet možných mikroskopických stavů systému, které jsou konzistentní s měřitelnou hodnotou své makroskopické proměnné, což způsobuje, že jakýkoli úplný popis stavu je komplikovanější. (Viz článek: Termodynamika maximální entropie). Maxwellův demon může (hypoteticky) snižovat termodynamickou entropii systému použitím informací o stavech jednotlivých molekul; ale jak ukázal v roce 1961 Rolf Landauer se svými spolupracovníky, aby démon sám fungoval, musí sám zvyšovat termodynamickou entropii v procesu, alespoň o množství Shannonovy informace, kterou potřebuje nejdřív získat a uložit; kvůli tomu se celková termodynamická entropie nesnižuje (což vysvětluje paradox). Landauerův princip určuje mimo jiné nejnižší množství tepla, které musí počítač vyprodukovat při zpracování určitého množství informací. Ani moderní počítače se k této efektivitě ani zdaleka neblíží.

Entropie jako informační obsah

Entropie je definovaná v kontextu pravděpodobnostního modelu. Nezávislý vrh poctivou mincí má entropii 1 bit na hod. Zdroj, které vždy generuje dlouhý řetězec znaků B má entropii 0, protože následující znak bude vždy 'B'.

Poměr entropie datového zdroje je průměrný počet bitů na symbol potřebných pro kódování tohoto zdroje. Shannonovy pokusy s lidmi jako prediktory ukazují, že anglický text má informační poměr 0,6 až 1,3 bitů na znak.[10] Komprimační algoritmus Prediction by partial matching (PPM) může na anglickém textu dosáhnout komprimačního poměru 1,5 bitu na znak.

V předchozím příkladě jsou důležité tyto body:

- Entropie vyjádřená v bitech nemusí být celé číslo.

- Mnoho bitů dat nenese žádné informace. Datové struktury často obsahují redundantní informace nebo mají identické části bez ohledu na to, jaké informace obsahují.

Pokud je Shannonova definice entropie aplikována na zdroj informace, může určovat minimální kapacitu kanálu nezbytnou pro spolehlivý přenos dat ze zdroje, pokud jsou zakódovány jako binární hodnoty (viz varování níže v kurzívě). Vzorec pro tuto kapacitu může být odvozen výpočtem matematického očekávání množství informace obsažené v každé číslici přenášených dat. Viz také Shannonova–Hartleyova věta.

Shannonova entropie měří informaci obsaženou ve zprávě jako protiklad k části zprávy, která je pevně určena (nebo předvídatelná). K dalším příkladům patří redundance ve struktuře jazyka nebo statistické vlastnosti týkající se frekvence výskytu dvojic, trojic, atd., písmen nebo slov. Viz Markovův řetězec.

Entropie jako míra rozmanitosti

Entropie je jedním ze způsobů, jak měřit rozmanitost. Konkrétně Shannonova entropie je logaritmus 1D, skutečný rozmanitost index s parametr rovné 1.

Komprese dat

Entropie efektivně limituje výkonnost nejsilnější bezztrátové komprimační metody, což lze teoreticky provést pomocí typické množiny nebo v praxi pomocí Huffmanova kódování, Lempel–Ziv nebo aritmetického kódování. Viz také Kolmogorovova složitost. V praxi komprimační algoritmy úmyslně zahrnují nějakou rozumnou redundanci ve formě kontrolního součtu pro zabezpečení proti chybám.

Světová technologická kapacita uložených a přenášených informací

Studie z roku 2011 v časopisu Science odhaduje světovou technologickou kapacitu pro uložení a přenos optimálně komprimovaných informací normalizovanou na nejefektivnější komprimační algoritmy dostupné v roce 2007, je vlastně odhadem entropie technologicky dostupný zdrojů.[11] :s.60–65

| Typ Informace | 1986 | 2007 |

|---|---|---|

| Uložení | 2,6 | 295 |

| Vysílání | 432 | 1900 |

| Telekomunikace | 0,281 | 65 |

Autoři odhadli technologickou kapacitu pro uložení (plně entropicky komprimovaných) informací, kterou má lidstvo k dispozici, v roce 1986 a 2007. Informace rozdělují do tří kategorií: objem datových médií, která byla k dispozici pro ukládání informací, množství informací předaných pomocí jednosměrných vysílacích sítí a výměnu informací pomocí obousměrných telekomunikační sítí.[11]

Omezení entropie jako informačního obsahu

Existuje několik dalších konceptů příbuzných entropii, které určitým způsobem matematicky kvantifikují informační obsah:

- Vlastní informace jednotlivé zprávy nebo symbolu vzatého z daného rozdělení pravděpodobnosti,

- entropie daného rozdělení pravděpodobnosti zpráv nebo symbolů a

- poměr entropie stochastického procesu.

(pro určité posloupnosti zpráv nebo symbolů generované daným stochastickým procesem může také definovat „poměr vlastní informace“, který je vždy roven poměru entropie v případě stacionárního procesu.) Jiná množství informace se také používají pro porovnávání různých zdrojů informace.

Výše uvedené koncepty si nesmíme plést. Často je zřejmé pouze z kontextu, který koncept se myslí. Když například někdo říká, že „entropie“ angličtiny je asi 1 bit na znak, jedná se o modelování angličtiny jako stochastického procesu a mluví se o poměru entropie. I sám Shannon používal termín podobně.

Při použití velmi velkých bloků může být odhad entropie na jeden znak uměle nízký, protože rozdělení pravděpodobnosti posloupnosti není známo přesně; je to pouze odhad. Pokud bychom uvažovali text každé dosud publikované knihy jako posloupnost, a text celé knihy bychom považovali za symbol, a jestliže je celkem N publikovaných knih a každá kniha je publikovaná pouze jednou, odhad pravděpodobnosti každé knihy je 1/N a entropie (v bitech) je −log2(1/N) = log2(N). Jako praktický kód to odpovídá přiřazení jednoznačného identifikátoru každé knize a používat ho místo textu knihy, když se chceme odkázat na text knihy. To je mimořádně užitečné pro mluvení o knihách, ale není to tak užitečné pro charakterizaci informačního obsahu jednotlivých knih nebo jazyka obecně: z identifikátoru knihy nelze rekonstruovat obsah knihy bez znalosti rozdělení pravděpodobnosti, tj. úplného textu všech knih. Klíčovou myšlenkou je, že musíme uvažovat složitost pravděpodobnostního modelu. Kolmogorovova složitost je teoretické zobecnění této myšlenky, která umožňuje zvážení informačního obsahu posloupnosti nezávislý na jakýkoli určitý pravděpodobnost model; uvažuje nejkratší program pro univerzální počítač, který vytvoří požadovanou posloupnost. Kód, který dosahuje poměru entropie posloupnosti pro daný model, plus kódová kniha (tj. pravděpodobnostní model), je jedním takovým programem, ale nemusí být nejkratší.

Fibonacciho posloupnost je 1, 1, 2, 3, 5, 8, 13, .... pokud uvažujeme posloupnost jako zprávu a každé číslo jako symbol, existuje téměř stejně symbolů jako znaků ve zprávě, což dává entropii přibližně log2(n). Prvních 128 symbolů Fibonacciho posloupnost má entropii přibližně 7 bitů/symbol, ale posloupnost lze vyjádřit pomocí vzorce [F(n) = F(n−1) + F(n−2) pro n = 3, 4, 5, …, F(1) =1, F(2) = 1] a toto vzorec má mnohem nižší entropie a je použita na jakýkoli délka Fibonacciho posloupnosti.

Omezení entropie v kryptografii

V kryptoanalýze se entropie často používá jako přibližná míra nepředvídatelnosti kryptografického klíče, jehož reálná nejistota je neměřitelná. Například 128bitový klíč, který je rovnoměrně a náhodně generovaný, má entropii 128 bitů. Také je třeba (v průměru) pokusů pro prolomení šifry hrubou silou. Entropie však selhává, jestliže možné klíče nejsou voleny rovnoměrně.[12][13] Místo toho lze použít míru nazývanou guesswork pro změření úsilí potřebného pro útok hrubou silou.[14]

V kryptografii se mohou objevit další problémy při používání entropie kvůli nerovnoměrnému rozdělení. Například jednorázová šifra, která šifruje text pomocí funkce xor s miliónem binárních číslic. Pokud má tabulka entropii milión bitů, je šifrování dokonalé. Pokud má šifra entropii jen 999 999 bitů, rovnoměrně distribuovaný (každý jednotlivý bit jednorázového hesla má entropii 0,999999 bitů) může stále poskytovat dobrou bezpečnost. Ale jestliže jednorázové heslo má entropii 999 999 bitů, přičemž první bit je pevný a zbývajících 999 999 bitů je naprosto náhodných, první bit šifrového textu nebude vůbec zašifrovaný.

Data jako Markovův proces

Obvyklý způsob, jak definovat entropii textu, vychází z Markovova modelu textu. Pro zdroj 0. řádu (každý znak je vybraný nezávisle na posledních znacích) je binární entropie:

kde pi je pravděpodobnost i. Pro Markovův zdroj prvního řádu (zdroj, u něhož je pravděpodobnost výběru znak závislá pouze na předchozím znaku), je poměr entropie (anglicky entropy rate):

kde i je stav (anglicky state) (určitý předchozí znaky) a je pravděpodobnost j daný i jako předchozí znak.

Pro Markovův zdroj druhého řádu je poměr entropie

b-ární entropie

Obecně b-ární entropie zdroje = (S, P) se zdrojovou abecedou S = {a1, …, an} a diskrétním rozdělením pravděpodobnosti P = {p1, …, pn}, kde pi je pravděpodobnost ai (značíme pi = p(ai)) je definovaný vztahem:

Hodnota b v „b-ární entropie“ je počet různých symbolů ideální abecedy používané jako standardní měřítko pro měření zdrojové abecedy. V teorii informace je pro kódování informací nutné a postačující, aby abeceda obsahovala dva symboly. Proto implicitně pracujeme s b = 2 („binární entropie“). Entropie zdrojové abecedy spolu s daným empirickým rozdělením pravděpodobnosti je číslo rovné počtu (případně zlomkovému) symbolů „ideální abecedy“ s optimálním rozdělením pravděpodobnosti nezbytných pro kódování každého symbolu zdrojové abecedy. Přitom „optimální rozdělení pravděpodobnosti“ zde znamená rovnoměrné rozdělení: zdrojová abeceda s n symboly má nejvyšší možnou entropii (mezi abecedami s n symboly), je-li rozdělení pravděpodobnosti abecedy rovnoměrné. Ukazuje se, že tato optimální entropie je logb(n).

Efektivita

Zdrojová abeceda s nerovnoměrným rozdělením bude mít menší entropii, než kdyby její symboly měly rovnoměrné rozdělení („optimalizovaná abeceda“). Tento nedostatek entropie lze vyjádřit poměrem nazývaným efektivita:

Použitím základních vlastností logaritmu lze tuto hodnotu také vyjádřit jako:

Efektivita je vhodnou mírou pro využití komunikačního kanálu. Uvedená veličina se také označuje normalizovaná entropie, protože entropie je dělena maximální entropií . Efektivita je navíc nezávislá na volbě základu b, jak je ukázáno výše.

Charakterizace

Shannonova entropie je charakterizována malým počtem dále uvedených kritérií. Jakákoli definice entropie, která těmto kritériím vyhovuje, má tvar

kde K je konstanta, která závisí na volbě jednotek měření.

V dalším textu budeme psát pi = Pr(X = xi) a Ηn(p1, …, pn) = Η(X).

Spojitost

Míra musí být spojitá, takže změna hodnoty pravděpodobnosti o velmi malou hodnotu způsobí pouze malou změnu entropie.

Symetrie

Míra nesmí záviset na pořadí výsledků xi.

- atd.

Maximální

Míra musí být maximální, jestliže všechny výsledky jsou stejně pravděpodobně (nejistota je nejvyšší, když všechny možné události mají stejnou pravděpodobnost).

Pro stejně pravděpodobné události se entropie musí zvyšovat s počtem výsledků.

Rozdělení, které má maximální diferenciální entropií pro spojité náhodné proměnné, je vícerozměrné normální rozdělení.

Aditivita

Velikost entropie musí být nezávislá na tom, jak je proces rozdělen do složek.

Tato poslední funkcionální podmínka charakterizuje entropii systému se subsystémy. Vyžaduje, aby entropii systému bylo možné spočítat z entropií jeho subsystémů, jestliže interakce mezi subsystémy jsou známé.

Je-li dán soubor n rovnoměrně distribuovaných prvků, které jsou rozděleny do k podsystémů, každý s b1, ..., bk prvky, entropie celého systému se musí rovnat sumě entropií jednotlivých podsystémů a entropií jednotlivých boxů, každý vážený s pravděpodobností, že je v příslušném podsystému.

Pro kladná celá čísla bi kde b1 + … + bk = n,

Pokud zvolíme k = n, b1 = … = bn = 1, z toto vyplývá, že entropie určitého výsledku je nulová: Η1(1) = 0. Z toho vyplývá, že efektivitu zdrojové abecedy s n symboly lze definovat jednoduše jako její n-ární entropii. Viz také Redundance (teorie informace).

Další vlastnosti

Shannonova entropie splňuje další vlastnosti; pro některé z nich je užitečné interpretovat entropii jako množství dodané informace (nebo odstraněné nejistoty), kterou přinese zjištění hodnoty náhodné proměnné X:

- Přidání nebo odstranění události s nulovou pravděpodobností nepřispívá k entropii:

- .

- Entropie diskrétní náhodné proměnné je nezáporné číslo:

- .[15]:s.15

- Užitím Jensenovy nerovnosti lze dokázat, že

- [15].:s.29

- Této maximální entropie logb(n) se efektivně dosáhne takovou zdrojovou abecedou, která má rovnoměrné rozdělení pravděpodobnosti: nejistota je maximální, když jsou všechny možné události stejně pravděpodobné.

- Entropie nebo množství informace získané vyhodnocením (X,Y) (tj. vyhodnocování X a Y současně) se rovná informaci získané provedením dvou pokusů po sobě: nejdříve vyhodnotíme hodnotu Y, potom hodnotu X se znalostí hodnoty Y. To lze napsat jako

- Pokud kde je funkce, pak . Použití předchozího vzorce na dává

- takže , entropie jedné náhodné proměnné se může snížit pouze tehdy, když na druhou proměnnou aplikujeme nějakou funkci.

- Pokud X a Y jsou dvě nezávislé náhodné proměnné, pak znalost hodnoty Y neovlivňuje naši znalost hodnoty X (protože tyto proměnné se vzájemně neovlivňují):

- Entropie dvou současných událostí není větší než suma entropií každé z událostí, přičemž rovnost nastane, jsou-li události nezávislé. Konkrétněji, jestliže X a Y jsou dvě náhodné proměnné na stejném pravděpodobnostním prostoru a (X, Y) označuje jejich kartézský součin, pak

- Entropie je konkávní v pravděpodobnostní funkci , tj.

- pro všechny pravděpodobnostní hmotové funkce a [15].:s.32

Rozšíření diskrétní entropie na spojitý případ

Diferenciální entropie

Shannonova entropie je definována pouze pro náhodné proměnné nabývající diskrétních hodnot. Odpovídající vzorec pro spojitou náhodnou proměnnou s hustotou pravděpodobnosti f(x) s konečným nebo nekonečným nosičem na reálné ose je možné definovat analogicky použitím výše uvedeného tvaru entropie jako střední hodnoty:

Tato veličina se obvykle nazývá spojitá entropie nebo diferenciální entropie. Předchůdcem spojité entropie h[f] je výraz pro funkcionál Η v Boltzmannově H-větě.

Přestože analogie mezi oběma funkcemi je sugestivní, je třeba položit otázku, zda je diferenciální entropie povoleným rozšířením Shannonovy diskrétní entropie. Diferenciální entropie postrádá některé vlastnosti Shannonovy diskrétní entropie – může být mimo jiné záporná – proto byly doporučovány opravy, především omezující hustota diskrétních bodů.

Aby bylo možné odpovědět na tuto otázku, je nutné ukázat spojení mezi těmito dvěma funkcemi:

Pro získání obecně konečné míry, když se velikost intervalů, na které je rozsah hodnot rozdělen, blíží k nule. V diskrétním případě je velikost intervalu (implicitní) šířkou každého z n (konečných nebo nekonečných) intervalů, jejíchž pravděpodobnosti jsou označeny pn. Když uvažujeme rozšíření na spojitý případ, šířka intervalu musí být stanovena explicitně.

Vyjdeme od spojité funkce f diskretizované na intervaly velikosti . Podle věty o střední hodnotě existuje hodnota xi v každém intervalu tak, že

integrál funkce f lze aproximovat (v Riemannovském smyslu) jako

kde tato limita odpovídá tomu, že „velikost intervalu se blíží k nule“.

Označíme

a rozepsáním logaritmu dostáváme

Pro Δ → 0 máme

Pamatujte, že log(Δ) → −∞ pro Δ → 0, vyžaduje speciální definici diferenciální nebo spojité entropie:

čemuž říkáme, jak již bylo řečeno, diferenciální entropie. To znamená, že diferenciální entropie není limitou Shannonovy entropie pro n → ∞. Naopak, liší se od limity Shannonovy entropie o nekonečné posunutí (viz také článek informační rozměr).

Omezení hustoty diskrétních bodů

Ukazuje se, že diferenciální entropie, na rozdíl od Shannonovy entropie, obecně není dobrou mírou nejistoty nebo informace. Diferenciální entropie může být například záporná; také není invariantní vůči spojité transformaci souřadnic. Tento problém může být ilustrován změnou jednotek, pokud by x byla veličina, která má fyzikální rozměr. f(x) pak bude mít rozměr 1/x. Argument logaritmu musí být bezrozměrný, jinak je nevlastní, takže diferenciální entropie definovaná výše bude nevlastní. Pokud Δ je nějaká „standardní“ hodnota x (tj. „velikost intervalu“) a proto má stejný rozměr, pak lze modifikovanou diferenciální entropii zapsat v patřičném tvaru jako:

Přičemž výsledek bude stejný pro jakoukoli volbu jednotek veličiny x. Totiž limita diskrétní entropie pro by také obsahovala člen , který by obecně byl nekonečný. To se dalo očekávat, protože po změně spojitých proměnných na diskrétní obvykle vyjde entropie nekonečná. Omezující hustota diskrétních bodů je skutečně mírou, o kolik snazší je popsat nějaké rozdělení než rozdělení, které je rovnoměrně přes své kvantizační schéma.

Relativní entropie

Další užitečnou mírou entropie, která funguje stejně dobře pro diskrétní i spojitý případ, je relativní entropie rozdělení. Je definovaná jako Kullbackova–Leiblerova divergence z rozdělení na reference míra m takto. Předpokládejme, že rozdělení pravděpodobnosti p je absolutně spojité vzhledem k míře m, tj. má tvar p(dx) = f(x)m(dx) pro nějakou nezápornou m-integrovatelnou funkci f s m-integrálem 1, pak lze relativní entropii definovat jako

V tomto tvaru relativní entropie zobecňuje (až na změnu znaménka) jak diskrétní entropii, kde míra m je počítací míra, tak diferenciální entropii, kde míra m je Lebesgueova míra. Pokud míra m je samotné rozdělení pravděpodobnosti, relativní entropie je nezáporná, a je nulová, jestliže p = m jako míry. Je definována pro jakýkoli prostor s mírou, je tedy nezávislá na volbě souřadnic a invariantní vůči změně souřadnic, jestliže správně bereme v úvahu transformaci míry m. Relativní entropie a implicitně entropie a diferenciální entropie, závisí na „referenční“ míře m.

Použití v kombinatorice

Entropie se stala užitečnou veličinou v kombinatorice.

Loomisova–Whitneyova nerovnost

Jejím jednoduchým příkladem je alternativní důkaz Loomisovy–Whitneyovy nerovnosti: pro každou podmnožinu A ⊆ Zd, máme

kde Pi je ortogonální projekce v i-té souřadnici:

Důkaz je jednoduchým důsledkem Shearerovy nerovnosti:, jestliže X1, …, Xd jsou náhodné proměnné a S1, …, Sn jsou podmnožiny množiny {1, …, d} takové, že každé celé číslo mezi 1 a d leží přesně v r těchto podmnožinách, pak

kde je kartézský součin náhodné proměnné Xj s indexy j v Si (takže rozměry tohoto vektoru se rovnají velikosti Si).

Načrtneme, jak z uvedeného vyplývá Loomisova–Whitneyova nerovnost: Nechť X je rovnoměrně distribuovaná náhodná proměnná s hodnotami v A, takže každá hodnota A má stejnou pravděpodobnost. Pak (z dalších vlastností entropie zmíněných výše) , kde označuje mohutnost množiny . Nechť Si = {1, 2, …, i−1, i+1, …, d}. Hodnoty jsou obsaženy v Pi(A), a tedy . To nyní použijeme pro omezení pravé strany Shearerovy nerovnosti a aplikujeme exponenciální funkci na obě strany výsledné nerovnosti.

Aproximace binomickým koeficientem

Pro celá čísla 0 < k < n položíme q = k/n. Pak

kde

- [16]:s.43

Zde je náčrt důkazu. Uvědomíme si, že je jeden člen výrazu

Přeskupení dává horní mez. Pro dolní mez musíme nejdřív ukázat pomocí nějaké algebry, že se jedná o největší člen v sumě. Ale pak,

protože suma má n + 1 členů. Přeskupení dává dolní mez.

Hezkým důsledkem je, že počet binárních řetězců délky n, které obsahují přesně k jedniček, je přibližně .[17]

Odkazy

Reference

V tomto článku byl použit překlad textu z článku Entropy (information theory) na anglické Wikipedii.

- ↑ PATHRIA, R. K.; BEALE, Paul. Statistical Mechanics. 3. vyd. [s.l.]: Academic Press, 2011. Dostupné online. ISBN 978-0123821881. S. 51.

- ↑ SHANNON, Claude E. A Mathematical Theory of Communication. Bell System Technical Journal. Červenec–říjen 1948, roč. 27, čís. 3, s. 379–423. Dostupné online. DOI 10.1002/j.1538-7305.1948.tb01338.x. (PDF, archivováno z původního zdroje)

- ↑ SHANNON, Claude E. A Mathematical Theory of Communication. Bell System Technical Journal. 1948, roč. 27, čís. 3, s. 379–423. Dostupné online. DOI 10.1002/j.1538-7305.1948.tb01338.x., červenec a říjen

- ↑ SCHNEIER, B. Applied Cryptography. 2. vyd. [s.l.]: John Wiley and Sons, 1996. Dostupné online.

- ↑ BORDA, Monica. Fundamentals in Information Theory and Coding. [s.l.]: Springer, 2011. Dostupné online. ISBN 978-3-642-20346-6.

- ↑ Mathematics of Information and Coding. [s.l.]: American Mathematical Society, 2002. Dostupné online. ISBN 978-0-8218-4256-0.

- ↑ SCHNEIDER, T.D. Information theory primer with an appendix on logarithms [online]. National Cancer Institute, 2007-04-14. Dostupné online.

- ↑ CARTER, Tom. An introduction to information theory and entropy. Santa Fe: [s.n.], březen 2014. Dostupné online.

- ↑ Srovnejte: Boltzmann, Ludwig (1896, 1898). Vorlesungen über Gastheorie : 2 Volumes – Lipsko 1895/98 UB: O 5262-6. anglická verze: Lectures on gas theory. Překlad Stephen G. Brush (1964) Berkeley: University of California Press; (1995) New York: Dover ISBN 0-486-68455-5

- ↑ Mark Nelson. The Hutter Prize [online]. 2006-08-24 [cit. 2008-11-27]. Dostupné v archivu pořízeném dne 2018-03-01.

- ↑ a b "The World's Technological Capacity to Store, Communicate, and Compute Information", Martin Hilbert a Priscila López (2011), Science, 332(6025); volný přístup k článku: [martinhilbert.net/WorldInfoCapacity.html]

- ↑ MASSEY, James. Guessing and Entropy. In: Proc. IEEE International Symposium on Information Theory. [s.l.]: [s.n.], 1994. Dostupné online.

- ↑ MALONE, David; SULLIVAN, Wayne. Guesswork is not a Substitute for Entropy. In: Proceedings of the Information Technology & Telecommunications Conference. [s.l.]: [s.n.], 2005. Dostupné online.

- ↑ PLIAM, John. Guesswork and variation distance as measures of cipher security. In: International Workshop on Selected Areas in Cryptography. [s.l.]: [s.n.], 1999. DOI 10.1007/3-540-46513-8_5.

- ↑ a b c Elements of Information Theory. Hoboken, New Jersey: Wiley, 2006-07-18. Dostupné online. ISBN 978-0-471-24195-9.

- ↑ Aoki, New Approaches to Macroeconomic Modeling.

- ↑ Probability and Computing, M. Mitzenmacher and E. Upfal, Cambridge University Press

Tento článek obsahuje informace z článku Shannon's entropy z encyklopedie PlanetMath, jejíž licence je podobná licencím Creative Commons Attribution/Share-Alike.

Související články

- Podmíněná entropie

- Křížová entropie – míra průměrného počtu bitů potřebné pro identifikaci události ze sady možností mezi dvěma rozděleními pravděpodobnosti

- Index rozmanitosti – alternativa se blíží pro určení množství rozmanitost v rozdělení pravděpodobnosti

- Entropie (šipka času)

- Entropické kódování – kódovací schéma, které přiřazuje kódy na symboly tak jako vyhovovat délkám kódu s pravděpodobností symbolů.

- Odhad entropie

- Nerovnost entropické síly

- Poměr entropií

- Fisherova informace

- Grafová entropie

- Hammingova vzdálenost

- Historie entropie

- Historie teorie informace

- Informační geometrie

- Sdružená entropie – míra, kolik entropie je obsaženo ve sdruženém systému dvou náhodných proměnných.

- Kolmogorovova–Sinaiova entropie v dynamických systémech

- Levenštejnova vzdálenost

- Vzájemná informace

- Negentropie

- Perplexita

- Kvalitativní variace – jiné míry variability pro nominální rozdělení

- Kvantová relativní entropie – míra rozlišitelnosti mezi dvěma kvantovými stavy.

- Rényiho entropie – zobecnění Shannonovy entropie; je jedním z rodiny funkcionálů pro kvantifikaci rozmanitosti, nejistoty nebo náhodnosti systému.

- Náhoda

- Shannonův index

- Theilův index

- Typoglykemie

Literatura

- Arndt, C. (2004), Information Measures: Information and its Description in Science and Engineering, Springer, ISBN 978-3-540-40855-0

- Cover, T. M., Thomas, J. A. (2006), Elements of information theory, 2. Edition. Wiley-Interscience. ISBN 0-471-24195-4.

- Gray, R. M. (2011), Entropy and Information Theory, Springer.

- MacKay, David J. C.. Information Theory, Inference, and Learning Algorithms Cambridge: Cambridge University Press, 2003. ISBN 0-521-64298-1

- Mathematical Theory of Entropy. [s.l.]: Cambridge University Press, 2011. Dostupné online. ISBN 978-0-521-17738-2.

- Shannon, C.E., Weaver, W. (1949) The Mathematical Theory of Communication, Univ of Illinois Press. ISBN 0-252-72548-4

- Stone, J. V. (2014), Chapter 1 of Information Theory: A Tutorial Introduction, University of Sheffield, Anglie. ISBN 978-0956372857.

Externí odkazy

Obrázky, zvuky či videa k tématu entropie informací na Wikimedia Commons

Obrázky, zvuky či videa k tématu entropie informací na Wikimedia Commons

- Entropy Encyclopædia of Mathematics, EMS Press 2004 (1994)

- Introduction to entropy and information na webu Principia Cybernetica Web

- Entropy interdisciplinární časopis o různých aspektech konceptu entropie. Volný přístup.

- Description of information entropy from "Tools for Thought" by Howard Rheingold

- A java applet representing Shannon's Experiment to Calculate the Entropy of English

- Slidy o nárůstu informace a entropii

- An Intuitive Guide to the Concept of Entropy Arising in Various Sectors of Science – wikibook o interpretaci konceptu entropie.

- Network Event Detection With Entropy Measures, Dr. Raimund Eimann, University of Auckland, PDF; 5993 kB – PhD práce, která se zabývá tím, jak lze měření entropie použít pro detekci anomálií v sítích.

- "Entropy" na Rosetta Code – repozitář implementací výpočtu Shannonovy entropie v různých programovacích jazycích.

- "Information Theory for Intelligent People". Krátký úvod do axiómů teorie informace, entropie, vzájemné informace, Kullbackovy–Lieblerovy divergence a Jensenovy–Shannonovu vzdálenosti.

- Online nástroj pro výpočet entropie (plain text)

- Online nástroj pro výpočet entropie (binary)

![S=-\sum _{i}P_{i}\log {P_{i}}=-\operatorname {E} _{P}[\log P],](https://wikimedia.org/api/rest_v1/media/math/render/svg/cfc75e2a9bb7eb2d41169e803fc8e340e82f03dc)

![{\displaystyle \operatorname {E} _{P}[X]=\sum _{i}P_{i}X_{i}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/5384dfc4d0364a254b0e5ae7e0a265069bc10ef1)

![{\displaystyle \mathrm {H} (X)=\operatorname {E} [\operatorname {I} (X)]=\operatorname {E} [-\log(\mathrm {P} (X))].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9fe426293e1fdb4a1d0d23ec9c5beec9a6d2e162)

![{\displaystyle \mathrm {H} (X)=\operatorname {E} \left[\log _{b}\left({\frac {1}{p(X)}}\right)\right]\leq \log _{b}\left(\operatorname {E} \left[{\frac {1}{p(X)}}\right]\right)=\log _{b}(n)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/e25cc561059371b9c345934747aa8b3902daf136)

![{\displaystyle h[f]=\operatorname {E} [-\ln(f(x))]=-\int _{\mathbb {X} }f(x)\ln(f(x))\,dx.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/4fdf6b07591f4dea485923a54568896dcfaf74fe)

![{\displaystyle h[f]=\lim _{\Delta \to 0}\left(\mathrm {H} ^{\Delta }+\log \Delta \right)=-\int _{-\infty }^{\infty }f(x)\log f(x)\,dx,}](https://wikimedia.org/api/rest_v1/media/math/render/svg/6d522982a9afc1539b88695a28b7aa3ffd2fa2d8)

![{\displaystyle \mathrm {H} [(X_{1},\ldots ,X_{d})]\leq {\frac {1}{r}}\sum _{i=1}^{n}\mathrm {H} [(X_{j})_{j\in S_{i}}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f6d219e5f3250e54a77586cd05731ff2ee0db7ee)

![{\displaystyle \mathrm {H} [(X_{j})_{j\in S_{i}}]\leq \log |P_{i}(A)|}](https://wikimedia.org/api/rest_v1/media/math/render/svg/e775922b5cf13b31bbf4fec16e82d4f492378cba)